IT之家4月3日消息,今日,谷歌正式推出Gemma4大模型,据称是迄今为止谷歌最智能的开源模型。Gemma4专为高级推理与智能体工作流打造,实现了前所未有的“单位参数智能水平”。

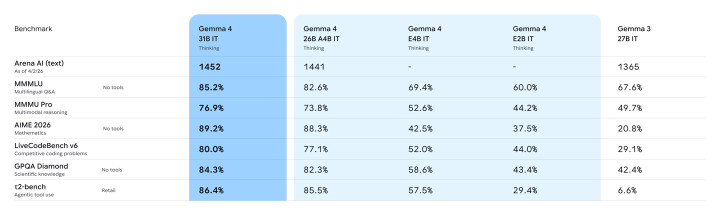

IT之家注意到,本次谷歌推出四种规格的Gemma4通用模型:高效20亿参数版(E2B)、高效40亿参数版(E4B)、260亿混合专家模型(MoE)与310亿稠密模型(31B)。全系产品均超越简单对话场景,可处理复杂逻辑与智能体工作流。

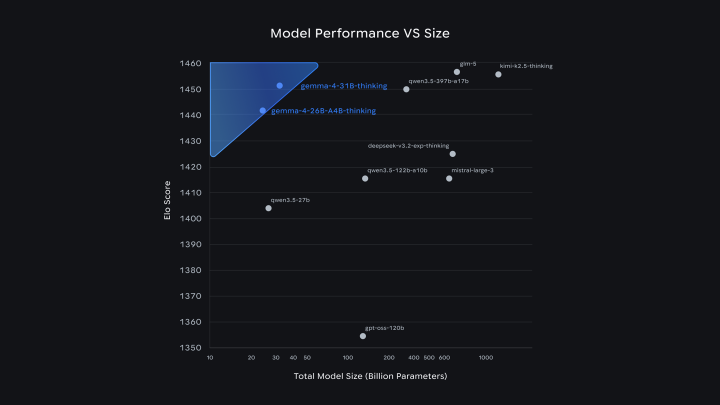

其中大参数量级模型在同规模下实现顶尖性能:31B模型目前在行业标准ArenaAI文本榜单中位列全球开源模型第三,26B模型位居第六。Gemma4在榜单上的表现甚至超越了自身规模20倍的模型。对开发者而言,这种全新的单位参数智能水平意味着,只需更少的硬件开销,即可实现前沿级AI能力。

在端侧设备上,E2B与E4B模型重新定义了本地部署价值:相比单纯堆砌参数,更侧重多模态能力、低延迟处理与生态无缝集成。

以下是Gemma4模型系列的核心优势:

高级推理:具备多步规划与深度逻辑能力,在数学、指令执行等需要复杂推理的基准测试中实现显著提升。

智能体工作流:原生支持函数调用、结构化JSON输出与系统指令,可构建能对接各类工具、API并可靠执行工作流的自主智能体。

代码生成:支持高质量离线代码生成,将工作站变为本地化AI编程助手。

视觉与音频:全系模型原生支持视频、图像处理,兼容可变分辨率,在OCR、图表理解等视觉任务上表现出色;E2B与E4B模型额外搭载原生音频输入能力,可实现语音识别与理解。

更长上下文:流畅处理长文本内容。端侧模型上下文窗口达128K,大模型最高支持256K,可在单次提示中传入代码库或长文档。

140+种语言:基于超140种语言原生训练,助力开发者为全球用户打造包容、高性能的应用。

26B与31B模型

为让研究者与开发者在通用硬件上实现顶尖推理能力而优化,非量化bfloat16权重可高效适配单张80GB英伟达H100GPU;本地部署场景下,量化版本可直接在消费级GPU上运行,支撑集成开发环境、编程助手与智能体工作流。26B混合专家模型(MoE)侧重低延迟,推理时仅激活总参数中的38亿,实现极快的令牌生成速度;31B稠密模型则最大化原始性能,为微调提供强大基础。

E2B与E4B模型

从底层设计便追求极致算力与内存效率,推理时实际占用参数分别为20亿与40亿,节省内存与设备电量。与谷歌Pixel团队、高通、联发科等移动硬件厂商深度合作,让这些多模态模型可在手机、树莓派、英伟达JetsonOrinNano等端侧设备上完全离线、近零延迟运行。安卓开发者现已可在AICore开发者预览版中搭建智能体流程,实现与GeminiNano4的向前兼容。

鑫耀证券炒股配资平台提示:文章来自网络,不代表本站观点。